Boom der Rechenzentren heizt sich auf

Von Bernard Lee

Höhere Betriebstemperaturen in Rechenzentren beeinträchtigen die Zuverlässigkeit von Glasfasern

Big Data Analytics, The Cloud, Internet of Thing: Die Schlagworte in der IKT-Branche (Informations- und Kommunikationstechnologie). All dies treibt den florierenden Markt für Rechenzentren auf der ganzen Welt in alarmierendem Tempo voran. Cisco prognostiziert, dass bis 2018 mehr als drei Viertel (78%) der Arbeitslasten von Cloud-Rechenzentren verarbeitet werden; 22 Prozent werden von traditionellen Rechenzentren verarbeitet. Obwohl sich die Gesamtarbeitslasten in Rechenzentren von 2013 bis 2018 fast verdoppeln (1,9-fach) werden, werden sich die Cloud-Arbeitslasten im gleichen Zeitraum fast verdreifachen (2,9-fach). Die Arbeitslastdichte (d. h. die Arbeitslast pro physischem Server) für Cloud-Rechenzentren lag 2013 bei 5,2 und wird bis 2018 auf 7,5 ansteigen.

Große Chancen bringen große Herausforderungen mit sich. Fragt man Betreiber von Rechenzentren "Was ist die größte Herausforderung beim Betrieb eines Rechenzentrums?", werden zweifellos alle antworten, dass es die Kosten für das HLK-System (Luftfeuchtigkeit, Belüftung und Klimatisierung) des Rechenzentrums sind. In vielen Rechenzentren belaufen sich die jährlichen Kosten für die HLK auf mehrere Millionen Dollar, und angesichts der steigenden Energiekosten ist dies der wichtigste Posten, den viele Betreiber von Rechenzentren gerne reduziert sehen würden. Aber warum ist die HLK in Rechenzentren so kostspielig? In der Vergangenheit wurde in Rechenzentren eine Präzisionskühlung eingesetzt, um die Umgebung innerhalb des Rechenzentrums rund um die Uhr innerhalb strenger Grenzen zu regeln, was auf Praktiken beruht, die bis in die 1950er Jahre zurückreichen. Steigende Energiekosten und die drohende Besteuerung von Kohlendioxid veranlassen jedoch viele Unternehmen, die Energieeffizienz von Rechenzentren und die Annahmen, auf denen ihre bisherigen Praktiken beruhen, zu überdenken. Daher die Frage: "Müssen Rechenzentren immer so kalt sein?"

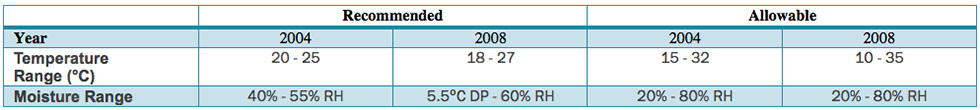

Im Laufe der Zeit hat die IT-Industrie an neuen Innovationen gearbeitet, um die zulässigen Temperatur- und Feuchtigkeitsbereiche auszuweiten. Es wird allgemein angenommen, dass der Betrieb bei Temperaturen, die über den typischen Arbeitsbedingungen liegen, negative Auswirkungen auf die Zuverlässigkeit von elektronischen und elektrischen Systemen haben kann. Die Auswirkungen der Betriebsbedingungen auf die Zuverlässigkeit und Lebensdauer von IT-Systemen sind jedoch bei Betreibern und IT-Benutzern nur unzureichend bekannt. Die Verwendung einer lockereren Umgebung führt zu einer potenziellen Senkung einiger der Betriebskosten, die mit den HVAC-Systemen eines Rechenzentrums verbunden sind. Insbesondere Rechenzentren, die keine mechanische Kühlanlage benötigen und sich auf Economizer stützen, können sowohl in der Errichtung als auch im Betrieb deutlich kostengünstiger sein. Eine solche Methode ist der Einsatz einer natürlichen Luftkühlung, die als "Airside Cooling" bekannt ist. Wie groß ist der Einfluss auf die Einsparungen? Der Vizepräsident von Gartner, David Cappuccio, schätzt, dass eine Erhöhung der Temperatur um 1°F monatlich etwa 3% an Energiekosten einsparen kann. Was ist die ideale Temperatur, ohne die Zuverlässigkeit zu beeinträchtigen? Wie heiß können wir die Geräte zum Arbeiten bringen, ohne das Risiko eines Ausfalls zu erhöhen? Um der IT- und Rechenzentrumsbranche eine Orientierung zu geben, hat die American Society of Heating, Refrigerating and Air-Conditioning Engineers (ASHRAE) im Jahr 2004 ihren ersten Leitfaden zu empfohlenen Luftfeuchtigkeits- und Temperaturwerten herausgegeben. 2008 wurde dieses Dokument überarbeitet, um die neuen vereinbarten Bereiche zu berücksichtigen, die in Tabelle 1 dargestellt sind

In ihren Leitlinien hat die ASHRAE zwei Betriebsbereiche definiert: "Empfohlen" und "Erlaubt". Der Betrieb im empfohlenen Bereich kann eine maximale Zuverlässigkeit und Lebensdauer der Geräte gewährleisten und gleichzeitig den Energieverbrauch der Geräte minimieren, sofern die thermischen und feuchten Umgebungsbedingungen diese Faktoren beeinflussen. Der zulässige Bereich ermöglicht den Betrieb von IT-Geräten mit größeren Toleranzen, wobei einige "potenzielle Zuverlässigkeitsrisiken" aufgrund von elektrostatischen Entladungen (ESD), Korrosion oder temperaturbedingten Ausfällen in Kauf genommen und der potenziell höhere Stromverbrauch der IT-Geräte in Kauf genommen wird. Dennoch unterstützen viele Anbieter in der Branche Temperatur- und Feuchtigkeitsbereiche, die über den zulässigen Bereich der ASHRAE 2008 hinausgehen. Es ist wichtig zu wissen, dass die ASHRAE 2008-Richtlinie nur die vereinbarte Schnittmenge zwischen den Anbietern darstellt, die es ermöglicht, dass die Geräte mehrerer Anbieter im selben Rechenzentrum unter einem einzigen Betriebsregime betrieben werden können. Im Jahr 2011 hat ASHRAE seinen Leitfaden erneut aktualisiert, um zwei zusätzliche Betriebsklassen für Rechenzentren zu definieren, die Anbietern und Anwendern Betriebsdefinitionen mit höheren zulässigen Temperaturgrenzen für den Betrieb von bis zu 40°C bzw. 45°C bieten.

Eines der Unternehmen, das sein Augenmerk auf eine höhere Betriebstemperatur richtet, ist Google. Erik Teetzel, Energy Program Manager bei Google, sagte: "Die Empfehlung, die wir den Betreibern von Rechenzentren geben, ist, den Thermostat zu erhöhen. Google hat sein belgisches Rechenzentrum seit 2008 ohne Kältemaschine betrieben und verwendet eine natürliche Luftkühlung, bei der die Temperatur zu bestimmten Zeiten im Jahr auf bis zu 35 °C ansteigen kann. Das ist zu heiß für die Menschen, aber die Maschinen funktionieren weiterhin einwandfrei. Studien von Intel und Microsoft haben gezeigt, dass die meisten Server mit höheren Temperaturen und Außenluft gut zurechtkommen, was die Befürchtungen über höhere Hardwareausfallraten zerstreut. Tatsächlich hat Dell vor kurzem erklärt, dass es seine Server für den Betrieb in Umgebungen mit einer Temperatur von bis zu 45°C (115°F) garantieren würde, was ganze 20°C über der von der ASHRAE empfohlenen Betriebstemperatur liegt. Daher ist die weltweite Einführung höherer Betriebstemperaturen in Rechenzentren unvermeidlich.

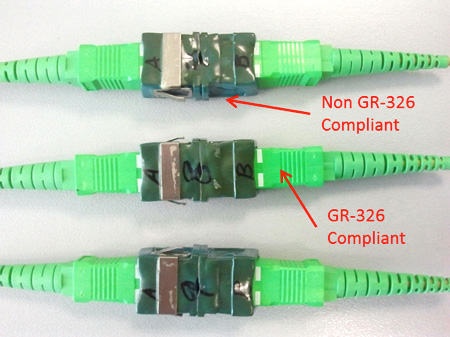

Abbildung 3 - Nicht normgerechtes Material, das den Umweltprüfungen nicht standhält

Wie wird es den passiven Infrastrukturen in Rechenzentren ergehen? Stellt die neue höhere Betriebstemperatur auch eine Gefahr für die Zuverlässigkeit dar? Glücklicherweise sind Betriebstemperaturen von 45 °C für passive Infrastrukturen nichts Unbekanntes, und seriöse Komponentenlieferanten haben schon immer Tests bei hohen Betriebstemperaturen gemäß internationalen Normen wie IEC 61753-1 und Telcordia GR-326-CORE durchgeführt. In einigen Testverfahren wird die Produktzuverlässigkeit bis zum Äußersten getrieben, indem Proben einer beschleunigten thermischen Alterung unterzogen werden, um eine Lebensdauer von etwa 20 Jahren zu simulieren. Dies ist eine sinnvolle Lebensdauer für passive Infrastrukturen, denn im Gegensatz zu aktiven Geräten, die eine Lebensdauer von etwa 5 Jahren haben (und manche sogar noch kürzer, bevor sie durch eine aktuellere Version ersetzt werden), werden passive Komponenten wie Überbrückungskabel, Verbindungskabel, Steckverbinder und Adapter sowie Kabelkanäle und -rohre nicht so häufig ersetzt. In einigen Fällen ist die passive Infrastruktur seit dem Tag der Inbetriebnahme des Rechenzentrums vorhanden und wird nur ausgetauscht, weil sie nicht mehr den geforderten Leistungsanforderungen entspricht und nicht, wie in Abbildung 3 dargestellt, weil Komponenten ausfallen. Im Grunde genommen ist die Einführung höherer Betriebstemperaturen in Rechenzentren unvermeidlich. Wir müssen nur sicherstellen, dass das, was wir heute entwerfen und installieren, diesen neuen Herausforderungen gewachsen ist.